当性能差距被缩小时,品牌和价值解释能力通常会成为新的护城河。

当性能差距被缩小时,品牌和价值解释能力通常会成为新的护城河。

开发者的核心价值,正在从亲手实现所有细节转向定义任务、约束质量并管理多个执行体。

AI 真正普及的关键,可能不是参数规模,而是它能不能进入人类那些不那么标准化的日常缝隙。

很多人谈论AI时,默认它会提升所有人的效率。但从近期的就业市场信号来看,实际情况并非如此平均。

AI 并没有平等改善所有人的职业处境,它更像一个能力放大器。

它会让本来就有判断力、工具能力和独立交付能力的人,产出进一步放大;也会让那些主要依赖重复执行、流程衔接和中间协调工作的人,更快感受到岗位压力。

这意味着,科技就业正在进入一种越来越明显的 K 型分化:一端是更能借助 AI 放大价值的人;另一端则是被更高要求重新筛选、持续承压的中间层岗位。

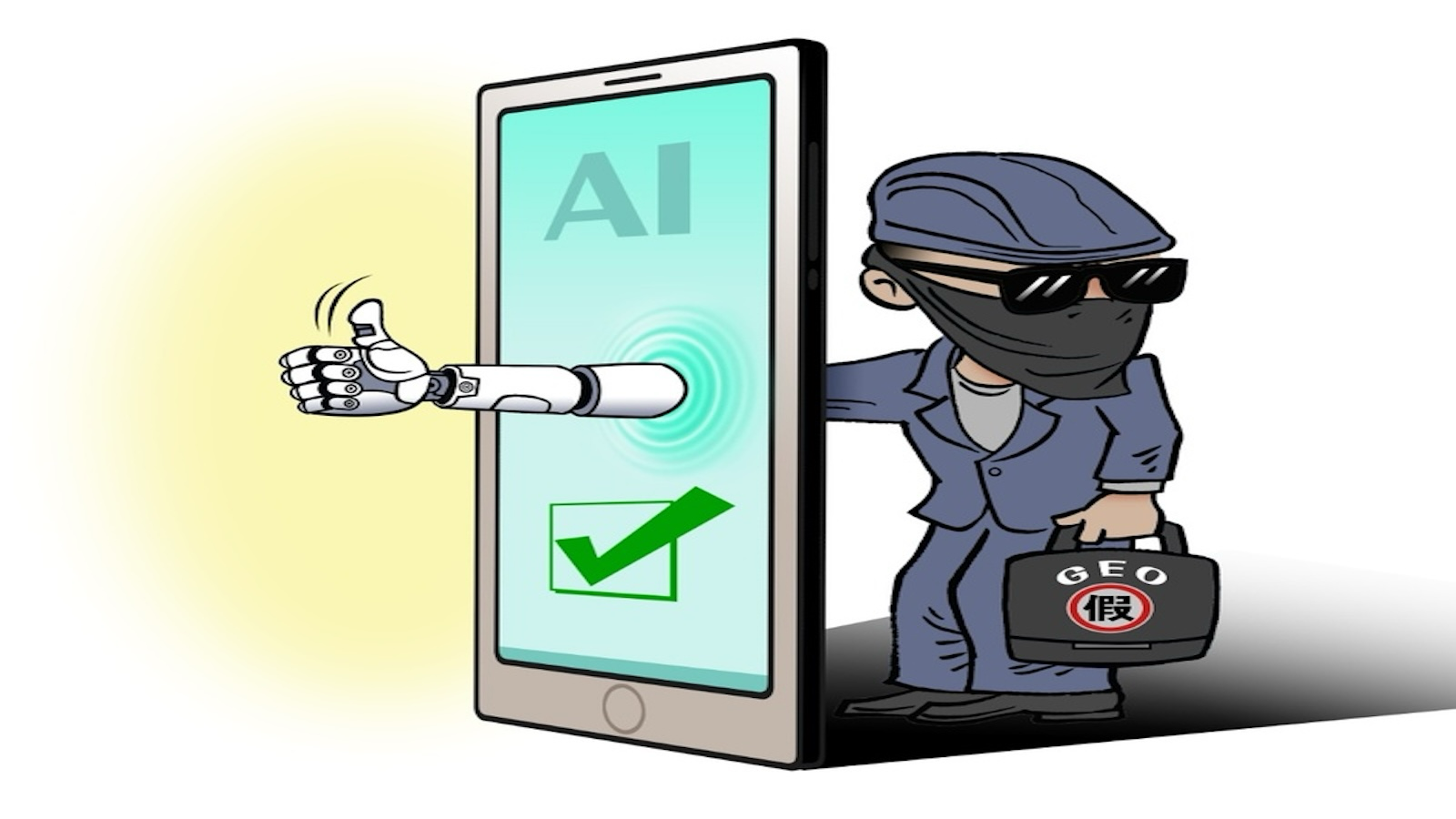

今年 3·15 晚会曝光了黑产通过 GEO(生成式引擎优化)技术给 AI"投毒"的事件。

被点名的力擎 GEO 优化系统,可以通过批量制造虚假信息、伪装内容来源,直接影响 AI 的推荐结果。更夸张的是,这项服务还提供抹黑竞品功能,通过向 AI 投喂虚假信息,干扰竞争对手的搜索表现。

这已经不是传统意义上的"软文"了,而是对"答案本身"的操控。

核心观点使用 AI 分析总结,笔者进行了一些调整,仅供参考。

过去一年,AI 公司和政府的关系一直在升温,但大多数讨论还停留在“谁签了单”、“谁拿到资格”和“谁更贴近监管”的层面。

直到这次 Anthropic 与五角大楼的正面冲突,问题才真正被摊开:对于大模型公司来说,进入政府市场,已经不只是产品能力、报价和交付周期的竞争,而开始变成一场安全定义权的竞争。

它看上去像一次企业公关危机,甚至像一场舆论战,但如果把视角再拉远一点,会发现它更像一场前哨战。AI 厂商、政府采购规则、国家安全逻辑,以及企业自己坚持的技术伦理边界,第一次如此直接地撞在了一起。

马斯克说:"美国芯片可能因缺电而闲置。"

这不是危言耸听。当 xAI 开始自己买燃气轮机发电、英伟达跑去投资核能公司、美国紧急批准 750 亿美元电网扩建,透露出一个信号:

AI 竞争的下一站,不在机房里,而在机房外。

过去几年,内容平台最常见的治理词是反作弊,即处理刷量、搬运、作弊等行为。

但从这轮AI 魔改专项治理开始,风向已经变了。平台不再只打击违规操作,而是在主动修复认知失真。

换句话说,过去是防流量作假,现在是防认知污染。