【今日观察】Anthropic 与五角大楼的拉扯,或改写 AI 公司进入政府市场的规则

核心观点使用 AI 分析总结,笔者进行了一些调整,仅供参考。

过去一年,AI 公司和政府的关系一直在升温,但大多数讨论还停留在“谁签了单”、“谁拿到资格”和“谁更贴近监管”的层面。

直到这次 Anthropic 与五角大楼的正面冲突,问题才真正被摊开:对于大模型公司来说,进入政府市场,已经不只是产品能力、报价和交付周期的竞争,而开始变成一场安全定义权的竞争。

它看上去像一次企业公关危机,甚至像一场舆论战,但如果把视角再拉远一点,会发现它更像一场前哨战。AI 厂商、政府采购规则、国家安全逻辑,以及企业自己坚持的技术伦理边界,第一次如此直接地撞在了一起。

这不是普通的合作纠纷

目前的几条关键事实大致是这样:

第一,Anthropic 已明确表示,将就美国国防部把它列为“供应链风险”相关对象的决定发起法律挑战。Dario Amodei(Anthropic 联合创始人)公开称这一认定“在法律上站不住脚”,并准备把争议带到法院层面。这说明事情已经不是内部协调,也不是普通的招投标失利,而是进入了正式的制度对抗阶段。

第二,Anthropic 并没有完全切断与军方的关系。恰恰相反,Amodei 在公开表态里仍然释放出非常强的“继续合作”信号,公司不接受对方的认定,但愿意在过渡期内,以“名义成本”继续向相关国家安全团队提供模型和工程支持。这至少说明 Anthropic 当前的策略不是彻底翻脸,而是边打官司,边保留合作通道。

第三,这次争议之所以敏感,不只是因为它牵涉到一家公司,而是因为它触碰了一个更大的问题:政府是否可以把大模型公司直接纳入类似关键供应链的安全审查框架。一旦这个口子被打开,未来进入教育、医疗、政务、国防等高敏感行业的 AI 产品,审核门槛就不再只是合规,而可能变成更强势的国家安全评估。

换句话说,这件事表面上是 Anthropic 和五角大楼的分歧,底层却是在争夺一句话的解释权:大模型公司到底是普通的软件供应商,还是新的战略基础设施供应商。

为什么这次冲突格外不一样

如果把它和传统 SaaS 公司、云厂商的政府合作放在一起看,你会发现这次明显更复杂。传统企业软件卖给政府,核心问题通常是三类:

- 供应是否稳定

- 数据是否安全

- 服务是否合规

但大模型公司多了一层:模型本身会影响决策、分析、判断,甚至会在某些场景下参与行动链条。

这意味着,政府在看待 AI 厂商时,不会只把它当作一个IT 供应商。它更像是一个会嵌入情报分析、作战规划、网络攻防、自动化流程的能力节点。一旦被视为能力节点,采购逻辑就会发生变化:

- 不再只看价格和性能

- 也要看可控性、可替代性、政治可靠性

- 甚至还要看这家公司在伦理边界上的态度,是否会在关键场景拒绝配合

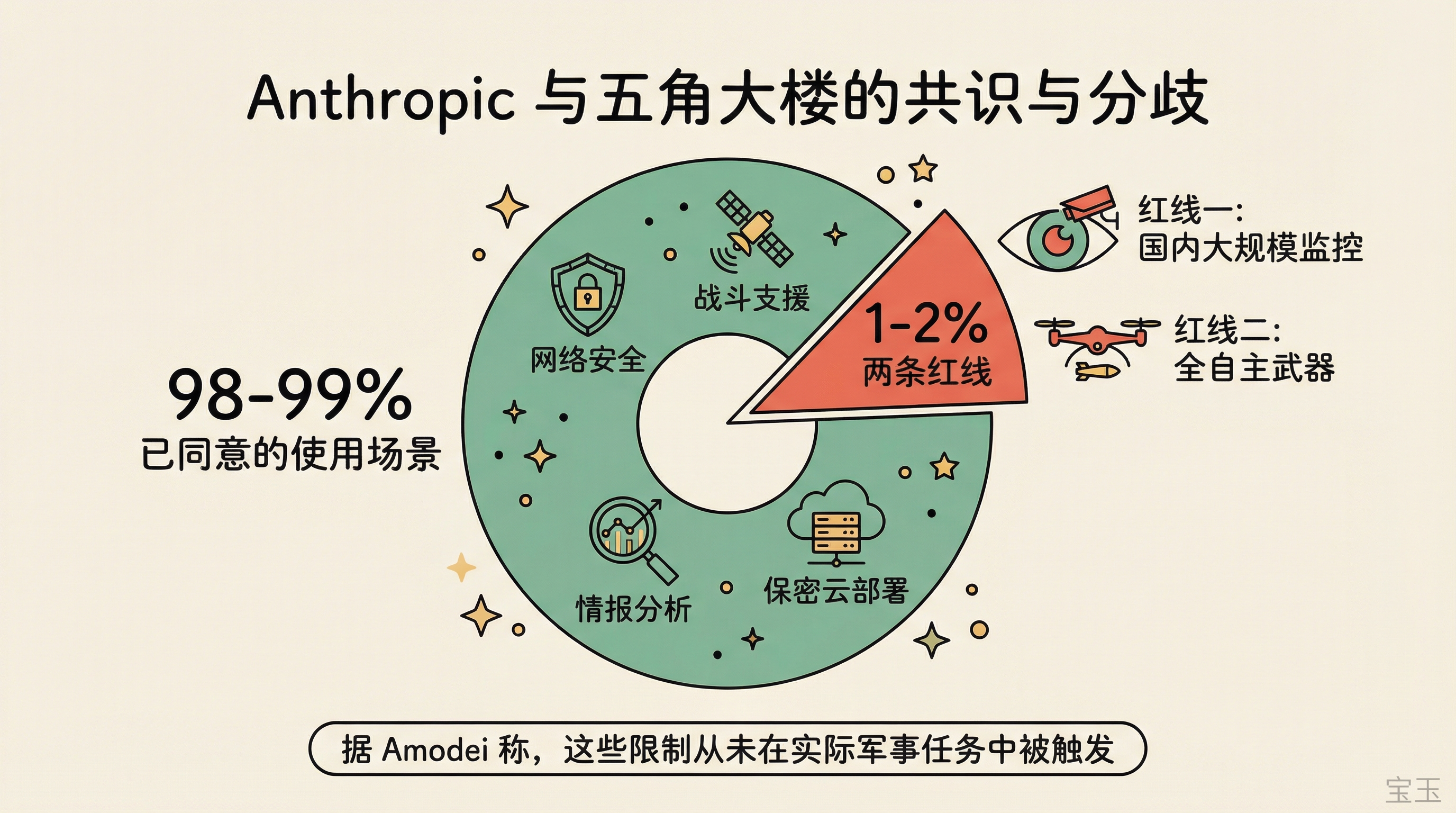

从公开信息看,Anthropic 的立场一直比较清楚:它愿意支持国家安全相关场景,但拒绝“完全自主武器”和“大规模国内监控”。这个边界在平时看起来像企业价值观,在军政合作场景里,却可能被对方理解成不够可控。

Anthropic 认为自己是在坚持底线,五角大楼则可能认为,一个不能在所有合法用途上完全开放的模型供应商,本身就构成不确定性。

于是,争议从能不能合作迅速升级成你是不是可信赖的供应链组成部分。

这件事可能会改写 AI 公司进入政府市场的路径

过去很多人对 AI 公司进政府市场的想象,还比较接近云计算时代。先做安全认证,再做私有化部署,再拿几个政企标杆案例,最后慢慢扩大规模。

但这次事件可能意味着,后面的路径不会这么平滑了。更现实的剧本,可能是下面这样:

① 只做能力验证已经不够了

以前一个模型如果效果好、响应快、成本低、支持私有部署,很多人会觉得这基本就够了。但未来进入政府市场的 AI 公司,可能还要额外证明:

- 公司治理足够稳定

- 对极端场景的政策足够明确

- 在危机状态下不会随意退出服务

- 不会因为内部伦理分歧而改变交付边界

- 能接受更强势、更深入的安全监督

这已经超出了传统产品验收的范围,更接近机构可靠性验收。

② “安全”从技术词变成政治词

这次最值得注意的一点,是“供应链风险”这个标签。

它看起来是个技术/采购术语,但落到现实里,几乎一定带有政治解释空间。因为风险的定义、最少限制的标准、关键时刻的供应保障,本来就很难完全技术化。

法院在国家安全问题上通常较为谨慎,不太愿意直接挑战政府判断。这意味着,只要争议被推入国家安全框架,企业在法律层面并不天然占优势。这也让一个趋势变得很清楚:

未来 AI 公司进入政府市场,面对的可能不是纯粹的技术审查,而是技术、法律、采购与政治共同作用的复合型审查。

③ 头部模型公司的分化会被进一步放大

这类审查一旦常态化,市场格局也会跟着变。

据公开报道,一些公司(如 OpenAI)可能会更主动拥抱政府需求,尽量少设边界,以换取更稳定的准入资格。另一些公司则会继续保留更强的伦理约束,但代价是政府市场推进速度更慢、风险更高。

这不会立刻决定谁赢谁输,但会让头部 AI 公司的商业路线变得越来越不一样:

- 有的公司更像国家级基础设施合作方

- 有的公司更像受监管的高能力模型提供商

- 还有一些公司可能干脆把重点放在企业市场和国际市场,减少对敏感采购体系的依赖

从这个角度看,Anthropic 与五角大楼的拉扯,未必只是一次危机,也可能是头部 AI 公司商业分层开始清晰化的标志。

普通人会受到哪些影响?

如果只把它当成华盛顿和硅谷之间的博弈,这件事会显得离普通用户很远。但实际上,它影响的并不只是军工订单。

因为政府市场对一个技术产业的影响,往往有很强的外溢性。

一旦政府采购体系开始把大模型公司视作关键供应链,类似逻辑很可能向其他高敏感行业扩散。教育、医疗、公共服务、金融、能源、交通,这些领域未来都可能提出类似的问题:

- 这家模型公司是否稳定?

- 是否可审计?

- 是否能接受更高强度的监管?

- 是否在关键场景会拒绝服务?

- 是否存在地缘政治或治理结构上的潜在风险?

对普通用户而言,这带来三个直接影响:

1. 你能用到什么 AI,不再只由产品力决定

未来进入公共体系的模型,首先要过可信赖这一关。一些技术上并非最强的模型,可能因更容易被监管而更早进入医院、学校等系统;而一些更强但边界复杂的模型,反而推进更慢。

2. AI 服务的价格和可用性会进一步分化

政府市场意味着大订单和稳定现金流。容易拿到合同的公司,在资金、算力和迭代上的优势会放大;而受限的公司则更依赖商业客户,导致各家模型在价格、功能开放程度、地区可用性上的差异越来越大。

3. 关于"AI 应该做什么"的争论会越来越具体

Anthropic 划定了不做自主武器、不做大规模监控的边界,而政府部门更强调所有合法用途的可用性。这类分歧未来只会增多,并从论文倡议走向真实影响采购和产品落地。AI 伦理不再是抽象价值观,而是真实决定你能接触到哪些产品、哪些能力被开放或限制。

结语

AI 公司进入政府市场,原本是一个顺理成章的增长故事:模型更强、需求更大、预算更足、场景更关键。

但 Anthropic 和五角大楼这次正面碰撞,提醒外界看到另一面:政府市场从来不只是大单市场,它首先是规则市场。谁能进去,靠的不只是能力,谁能留下,看的也不只是能力。

接下来几年,AI 产业的竞争大概率会出现一条新的分界线。一边是模型能力和产品体验,另一边是可信任、可审计、可纳入国家级采购逻辑的能力。

而真正决定长期格局的,不是谁跑得更快,而是谁能同时跑得稳。

感谢阅读

微信公众号「肖恩聊技术」

如果这篇文章对你有帮助,欢迎扫码关注,获取原创文章推送。

扫码关注公众号