这两年我越来越强烈地感觉到,信息问题早就不是获取不到,而是处理不过来。

真正让我疲惫的,不是没东西看,而是每天都有太多东西值得看:公众号文章、技术博客、GitHub Release、AI 新闻、社区讨论、长文、短讯、碎片化观点等等,全都在争夺我的注意力。

如果不做点什么,一个人的信息生活很容易退化成这样:

- 收藏夹里躺满了文章,真正读完的却寥寥无几

- 每天浏览大量内容,能留在脑子里的却屈指可数

- 输入看似充实,输出却异常薄弱

- 以为自己一直在吸收信息,实际上只是在不同窗口间疲于切换

这两年我越来越强烈地感觉到,信息问题早就不是获取不到,而是处理不过来。

真正让我疲惫的,不是没东西看,而是每天都有太多东西值得看:公众号文章、技术博客、GitHub Release、AI 新闻、社区讨论、长文、短讯、碎片化观点等等,全都在争夺我的注意力。

如果不做点什么,一个人的信息生活很容易退化成这样:

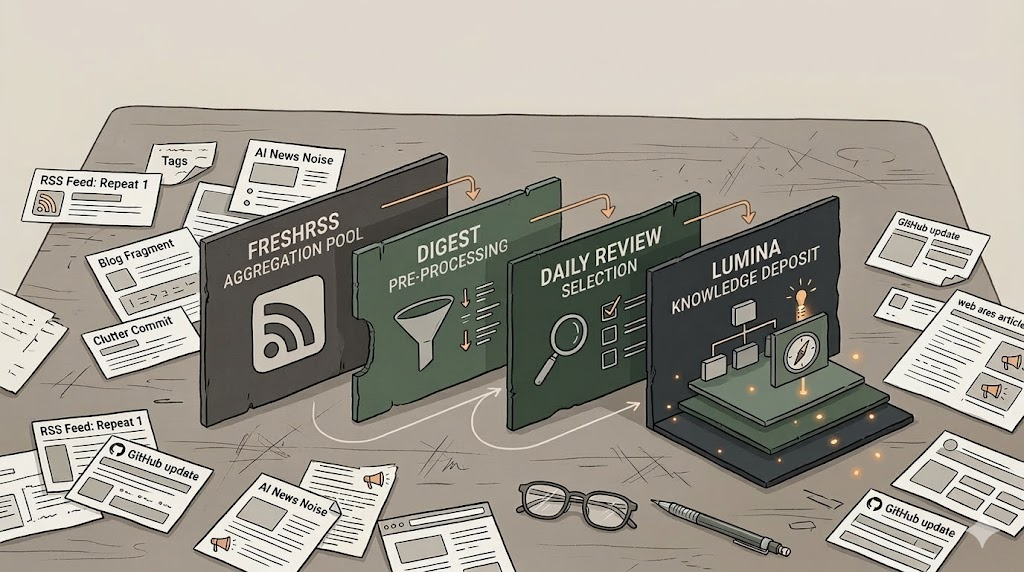

前文"信息过载时代,我的漏斗式阅读工作流"中,我详细描述了信息处理的漏斗式工作流:从信息源的广泛采集,到聚合池的稳定汇聚,再到预处理、AI 精选、精读留存和个人画像的完整链路。这套流程的核心理念是分层处理——并非所有信息都值得投入时间精读,也并非所有信息都值得长期留存。

但理念落地到工程层面,中间有大量"必要却繁琐"的预处理工作:RSS抓取、全文补全、噪音过滤、内容去重、质量评估、摘要生成、事件聚合、日报编排...这些环节如果靠手工或零散脚本拼凑,维护成本会随信息源数量线性增长,最终拖垮整套工作流的可持续性。

Infinitum 就是为了解决这些问题而诞生的。它是一个自托管的 RSS 资讯聚合工作台,目标不是替代阅读,而是将漏斗工作流中"中游稳定"和"下游精准"两个关键层的预处理能力进行工程化落地,让我们把精力留给真正需要判断的环节。

在信息越来越多、更新越来越快的环境里,真正困难的不是看不到内容,而是看到了很多,却很难留下真正重要的部分。

我们每天都会接触大量文章、博客、资讯、技术更新和社区讨论。大多数适合快速浏览,少数值得认真阅读,而仅有极少部分值得长期保留、反复查看,并在未来服务于写作、研究、复盘与输出。前文"信息过载时代,我的漏斗式阅读工作流"对信息处理工作流进行了详细描述,但更多在理论层面,并没有提供开箱即用的工具。

于是针对极少部分值得长期留存的内容,开发了工具 Lumina 。

它不是一个泛信息分发平台,也不是单纯的收藏工具。Lumina 更像一个围绕高价值内容构建的工作台,帮助用户把“发现一篇值得留下的文章”这件事,继续往后推进成一整套完整流程:采集、理解、整理、精读、回顾与再利用。

作为轻量级使用用户,性价比是唯一考虑因素。入选均为个人长期使用的高性价订阅产品,持续更新中...

大家通过下面链接注册订阅我能获取一点返佣,不求赚大钱,但能回回折腾的血🫶。

当性能差距被缩小时,品牌和价值解释能力通常会成为新的护城河。

开发者的核心价值,正在从亲手实现所有细节转向定义任务、约束质量并管理多个执行体。

AI 真正普及的关键,可能不是参数规模,而是它能不能进入人类那些不那么标准化的日常缝隙。

很多人谈论AI时,默认它会提升所有人的效率。但从近期的就业市场信号来看,实际情况并非如此平均。

AI 并没有平等改善所有人的职业处境,它更像一个能力放大器。

它会让本来就有判断力、工具能力和独立交付能力的人,产出进一步放大;也会让那些主要依赖重复执行、流程衔接和中间协调工作的人,更快感受到岗位压力。

这意味着,科技就业正在进入一种越来越明显的 K 型分化:一端是更能借助 AI 放大价值的人;另一端则是被更高要求重新筛选、持续承压的中间层岗位。

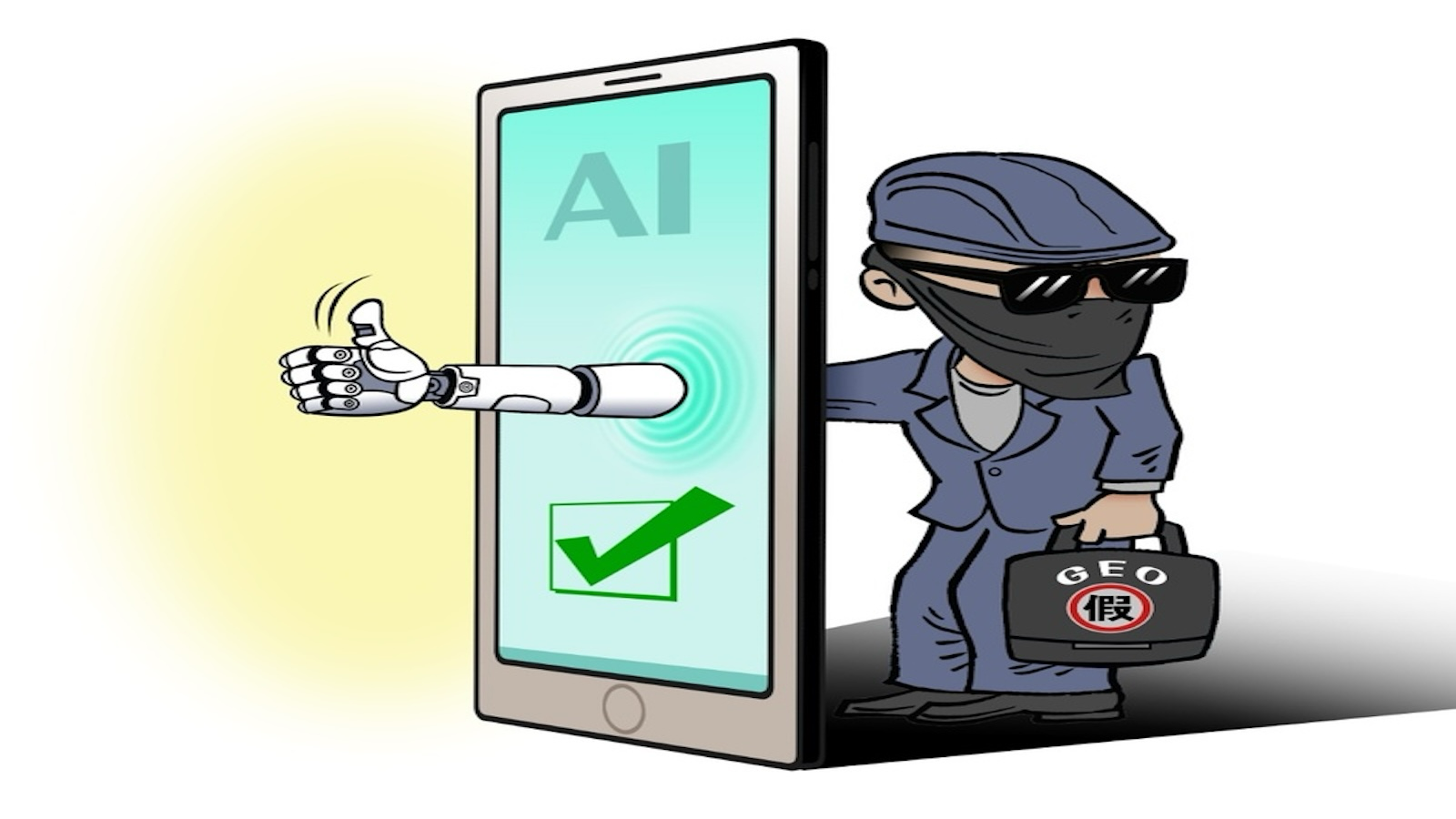

今年 3·15 晚会曝光了黑产通过 GEO(生成式引擎优化)技术给 AI"投毒"的事件。

被点名的力擎 GEO 优化系统,可以通过批量制造虚假信息、伪装内容来源,直接影响 AI 的推荐结果。更夸张的是,这项服务还提供抹黑竞品功能,通过向 AI 投喂虚假信息,干扰竞争对手的搜索表现。

这已经不是传统意义上的"软文"了,而是对"答案本身"的操控。

核心观点使用 AI 分析总结,笔者进行了一些调整,仅供参考。

过去一年,AI 公司和政府的关系一直在升温,但大多数讨论还停留在“谁签了单”、“谁拿到资格”和“谁更贴近监管”的层面。

直到这次 Anthropic 与五角大楼的正面冲突,问题才真正被摊开:对于大模型公司来说,进入政府市场,已经不只是产品能力、报价和交付周期的竞争,而开始变成一场安全定义权的竞争。

它看上去像一次企业公关危机,甚至像一场舆论战,但如果把视角再拉远一点,会发现它更像一场前哨战。AI 厂商、政府采购规则、国家安全逻辑,以及企业自己坚持的技术伦理边界,第一次如此直接地撞在了一起。